- ¿Qué es la seguridad de contenedores?

-

¿Qué es la seguridad de registro de contenedores?

- Explicación de la seguridad del registro de contenedores

- Componentes de la seguridad de registro de contenedores

- Fomento de la integridad de imágenes y artefactos en CI/CD

- Lista de comprobación de seguridad del registro de contenedores de un vistazo

- Preguntas frecuentes sobre el registro de contenedores

¿Qué es la orquestación de contenedores?

La orquestación de contenedores es una tecnología que automatiza la implementación, gestión y escalado de aplicaciones en contenedores. Simplifica las complejas tareas de gestión de un gran número de contenedores. Los orquestadores de contenedores, como Kubernetes, garantizan que estos contenedores interactúen eficientemente en diferentes servidores y entornos. Los orquestadores proporcionan un marco para gestionar los ciclos de vida de los contenedores, facilitar el descubrimiento de servicios y mantener una alta disponibilidad. Para arquitecturas de microservicios, en las que las aplicaciones cloud-native constan de numerosos componentes interdependientes, este marco es fundacional.

Al aprovechar la orquestación de contenedores, los equipos de DevOps pueden agilizar el aprovisionamiento, la asignación de recursos y el escalado, lo que les permite aprovechar plenamente el potencial de la contenedorización y alinearlo con sus objetivos empresariales.

Explicación de la orquestación de contenedores

La orquestación de contenedores automatiza la implementación, gestión y escalado de aplicaciones en contenedores. Las empresas aprovechan los orquestadores para controlar y coordinar un número masivo de contenedores, asegurándose de que interactúan de forma eficiente en diferentes servidores.

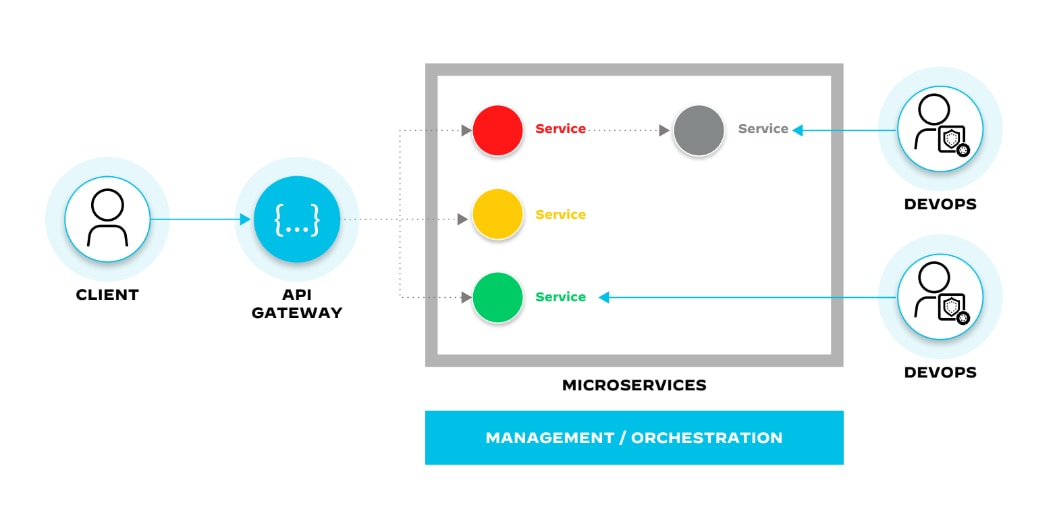

Figura 1: Capa de orquestación que implementa nuevas versiones de microservicios, escala los microservicios para satisfacer la demanda y supervisa el rendimiento y la salud de los microservicios.

Los orquestadores como Kubernetes gestionan los ciclos de vida, facilitan el descubrimiento de servicios y mantienen una alta disponibilidad. Permiten que los contenedores funcionen de forma concertada, lo que resulta esencial para las arquitecturas de microservicios en las que las aplicaciones nativas de la nube constan de numerosos componentes interdependientes.

De hecho, el mercado de la orquestación de contenedores sigue el ritmo de la adopción de las arquitecturas de microservicios, las aplicaciones nativas de la nube y la containerización. Calculado en 745,72 millones de dólares en 2022 -un 26% más en un lapso de cinco años-, el tamaño del mercado sigue subiendo y se espera que alcance los 1084.790 millones de dólares en 2029.

Herramientas de orquestación

Las herramientas de orquestación proporcionan un marco para automatizar las cargas de trabajo de los contenedores, lo que permite a los equipos de DevOps gestionar los ciclos de vida de sus contenedores. Estos sistemas, o motores de orquestación, facilitan capacidades avanzadas de red, agilizando el aprovisionamiento de contenedores y microservicios al tiempo que ajustan los recursos para satisfacer la demanda. Con los orquestadores, los equipos de DevOps pueden aprovechar todo el potencial de la contenedorización, alineándola con sus objetivos empresariales.

Motores populares de orquestación de contenedores

- Kubernetes® (K8s)

- Ranchero

- SUSE Rancher

- Servicios de Amazon Elastic Kubernetes (EKS)

- Servicios Azure Kubernetes (AKS)

- Motor Google Kubernetes (GKE) / Anthos

- Plataforma de contenedores Red Hat OpenShift (OCP)

- Mesos

- Plataforma de contenedores Cisco (CCP)

- Motor de contenedores Oracle para Kubernetes (OKE)

- Nube de contenedores de Ericsson (ECC)

- Enjambre Docker

- HashiCorp Nomad

La ventaja de los motores de orquestación procede del modelo declarativo que suelen emplear, que combina eficazmente las ventajas de infraestructura como servicio (IaaS) y plataforma como servicio (PaaS).

- IaaS proporciona el control granular y la automatización que permite a los desarrolladores gestionar la infraestructura subyacente, como servidores, almacenamiento y redes. Esto ofrece a los desarrolladores la flexibilidad de personalizar sus implementaciones para satisfacer necesidades específicas.

- PaaS proporciona un mayor nivel de abstracción que permite a los desarrolladores centrarse en sus aplicaciones sin tener que preocuparse por la infraestructura subyacente. PaaS facilita a los ingenieros la implementación y gestión de sus aplicaciones, pero también les proporciona menos control sobre la infraestructura.

Aprovechando lo mejor de ambos mundos, los orquestadores ofrecen a los desarrolladores potencia y flexibilidad, así como una experiencia operativa coherente en todos los entornos, desde máquinas físicas y centros de datos in situ hasta implementaciones virtuales y sistemas basados en la nube.

Las características principales de los motores de orquestación más destacados incluyen la programación, la gestión de recursos, el descubrimiento de servicios, las comprobaciones de estado, el autoescalado y la gestión de actualizaciones y mejoras.

Componentes clave de los orquestadores

La terminología de los componentes de la orquestación de contenedores varía según las herramientas que existen actualmente en el mercado. Sin embargo, los conceptos y funcionalidades subyacentes siguen siendo relativamente coherentes. La tabla 3 ofrece una visión comparativa de los componentes principales con la terminología correspondiente de los orquestadores de contenedores más populares. Para nuestros propósitos, para introducir un sentido de la mecánica de la orquestación, utilizaremos términos de Kubernetes.

Figura 2: Visión general del componente de orquestación de contenedores

Los motores de orquestación como Kubernetes son complejos y constan de varios componentes tecnológicos clave que funcionan al unísono para gestionar el ciclo de vida de los contenedores. Al conocer los componentes clave, comprenderá cómo utilizar mejor las tecnologías de contenedorización.

El plano de control

En el corazón de Kubernetes se encuentra su plano de control, el centro de mando para programar y gestionar el ciclo de vida de las aplicaciones. El plano de control expone la API de Kubernetes, orquesta las implementaciones y dirige la comunicación en todo el sistema. También supervisa el estado de los contenedores y gestiona el clúster, garantizando que las imágenes de contenedor estén disponibles en un registro para su implementación.

El plano de control de Kubernetes consta de varios componentes: el etcd, el servidor API, el programador y el controlador-gestor.

Etcd

El Almacén de datos etcd, desarrollado por CoreOS y posteriormente adquirido por Red Hat, es un almacén distribuido clave-valor que contiene los datos de configuración del cluster. Informa de las acciones del orquestador para mantener el estado deseado de la aplicación, definido por una política declarativa. Esta política esboza el entorno óptimo para una aplicación, guiando al orquestador en la gestión de propiedades como el recuento de instancias, las necesidades de almacenamiento y la asignación de recursos.

Servidor API

El servidor API de Kubernetes desempeña un papel fundamental, ya que expone las capacidades del clúster a través de una interfaz RESTful. Procesa las solicitudes, las valida y actualiza el estado del cluster en función de las instrucciones recibidas. Este mecanismo permite una configuración y gestión dinámicas de las cargas de trabajo y los recursos.

Programador

El programador de Kubernetes asigna las cargas de trabajo a los nodos trabajadores en función de la disponibilidad de recursos y otras restricciones, como la calidad del servicio y las reglas de afinidad. El programador garantiza que la distribución de las cargas de trabajo se mantenga optimizada para el estado actual del cluster y la configuración de los recursos.

Controlador-Gestor

El controlador-gestor mantiene el estado deseado de las aplicaciones. Funciona a través de controladores, bucles de control que supervisan el estado compartido de la agrupación y realizan ajustes para alinear el estado actual con el estado deseado. Estos controladores garantizan la estabilidad de los nodos y pods, respondiendo a los cambios en la salud del clúster para mantener la coherencia operativa.

| Orquestador de contenedores | Componentes del plano de control | Componentes del nodo trabajador | Unidad de implementación | Servicio |

|---|---|---|---|---|

| Kubernetes | Servidor API, programador, gestor de controladores, etcd | kubelet | Pod | Servicio |

| Enjambre Docker | Gerente | Trabajador | Servicio | Pila |

| Nómada | Servidor | Agente | Trabajo | Asignación |

| Mesos | Maestro | Agente | Tarea | Trabajo |

| OpenShift | Consola, Controller Manager, etcd | Nodo | Pod | Servicio |

| Amazon Elastic Container Service (ECS) | Controlador de clúster | Instancias EC2 | Tarea | Servicio |

| Motor Google Kubernetes (GKE) | Plano de control | Nodos | Pod | Servicio |

| Servicio Azure Kubernetes (AKS) | Plano de control | Nodos | Pod | Servicio |

Tabla 1: Componentes comunes a varios motores de orquestación.

Orquestación e infraestructura inmutable

En contraste con los servidores tradicionales y las máquinas virtuales, el paradigma inmutable en el que habitan los contenedores y su infraestructura hace que las modificaciones posteriores a su implementación sean inexistentes. En su lugar, las actualizaciones o correcciones se aplican implementando nuevos contenedores o servidores a partir de una imagen común con los cambios necesarios.

La programabilidad inherente a la infraestructura inmutable permite la automatización. La infraestructura como código (IaC) destaca como sello distintivo de la infraestructura moderna, ya que permite a las aplicaciones aprovisionar, configurar y gestionar de forma programática la infraestructura necesaria. La potencia combinada de la orquestación de contenedores, la infraestructura inmutable y la automatización impulsada por IaC ofrece una flexibilidad y una escalabilidad inigualables.

Orquestación de contenedores y la tubería

Impulsada por los motores gemelos de la contenedorización y DevOps, la orquestación de contenedores aúna velocidad y escalabilidad para respaldar el dinámico y exigente conducto de producciónde hoy en día.

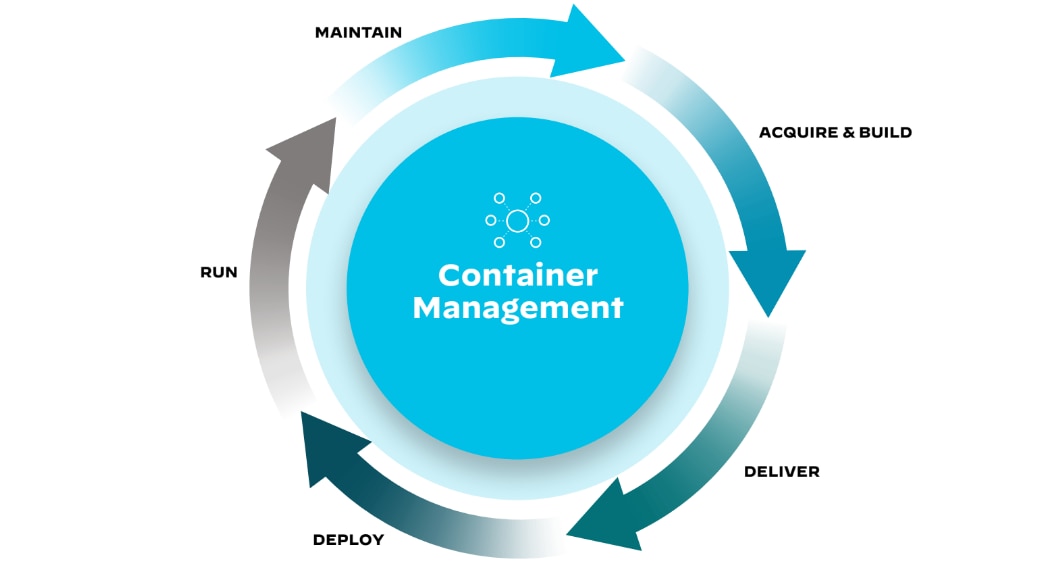

Figura 3: Ciclo de vida del desarrollo de aplicaciones CI/CD pipeline

Fase de adquisición y construcción

En la fase de adquisición y construcción, los desarrolladores extraen el código de los repositorios de control de versiones, iniciando el proceso de construcción. Las herramientas automatizadas compilan el código fuente en artefactos binarios preparados para su implementación mediante una herramienta como Docker o BuildKit. Una vez construida la imagen de contenedor, se almacena en un registro como Docker Hub o Google Artifact Registry.

La fase de adquisición y construcción promueve la construcción coherente de la aplicación, con scripts que gestionan las dependencias y ejecutan pruebas preliminares. El resultado es una construcción fiable que, cuando se integra con la rama principal, desencadena otros procesos automatizados.

Fase de ejecución

Cuando concluye la fase de compilación, la canalización ejecuta el código en un entorno controlado. La ejecución de la imagen de contenedor en un entorno de ensayo puede realizarse utilizando una herramienta de orquestación de contenedores como Kubernetes. Este paso crucial implica que el equipo lleve a cabo una serie de pruebas automatizadas para validar la funcionalidad de la aplicación. Los desarrolladores buscan y solucionan activamente los fallos, garantizando la progresión de sólo código de alta calidad a través del pipeline.

Fase de entrega

En la fase de entrega de la canalización CI/CD, los equipos automatizan el recorrido del nuevo código desde repositorio hasta la preparación para la producción. Cada commit inicia una secuencia de rigurosas pruebas automatizadas y comprobaciones de calidad, que garantizan que sólo el código bien validado llega al entorno de staging. Aquí, el software se somete a validaciones adicionales, a menudo de cara al cliente. El proceso encapsula el ascenso de la construcción a través de entornos, cada uno de los cuales sirve de campo de pruebas para la estabilidad y el rendimiento. El compromiso del equipo en la fase de entrega garantiza que el software encarna lo mejor de los esfuerzos de desarrollo actuales.

Fase de implementación

En la fase de implementación, la aplicación alcanza su momento crucial cuando los equipos la despliegan en el entorno de producción. Las herramientas de orquestación de contenedores, como Kubernetes, asumen el control, escalando la aplicación y actualizándola con un tiempo de inactividad mínimo. Los equipos tienen preparados mecanismos de reversión que les permiten volver a versiones anteriores si surge algún problema. En este punto, la aplicación pasa a ser operativa, sirviendo a sus usuarios previstos y cumpliendo su propósito en el ecosistema digital.

Mantener el escenario

Tras la implementación, el equipo pasa a mantener activamente la aplicación. Emplean una solución de tiempo de ejecución para supervisar continuamente el rendimiento, registrar los errores y recoger los comentarios de los usuarios, todo lo cual impulsa futuras mejoras, así como la seguridad de contenedor.

A medida que los desarrolladores afinan la aplicación, aplican parches de seguridad y despliegan nuevas funciones, la fase de mantenimiento subraya la naturaleza iterativa del desarrollo moderno de aplicaciones. Invariablemente, el producto sigue evolucionando para satisfacer las demandas de los usuarios e integrar los últimos avances tecnológicos.

Ventajas de la orquestación de contenedores

La orquestación de contenedores ofrece un conjunto de ventajas que se alinean con los objetivos de DevOps, mejorando en última instancia la eficacia operativa y reduciendo los gastos generales en entornos de nube.

Mejora la escalabilidad

Las plataformas de orquestación de contenedores permiten a las empresas escalar las aplicaciones en contenedores en respuesta a una demanda fluctuante, sin intervención humana ni intentar predecir la carga de las aplicaciones. Las capacidades de empaquetado y autoescalado del orquestador, junto con la infraestructura de nube pública como código, asignan recursos de forma dinámica, garantizando un rendimiento óptimo durante los picos de carga.

Facilita la resiliencia

Al distribuir las instancias de los contenedores entre varios hosts, las herramientas de orquestación refuerzan la resistencia de las aplicaciones. Detectan los fallos y reinician automáticamente los contenedores, minimizando el tiempo de inactividad y manteniendo la continuidad del servicio.

Fomenta la eficacia

Los motores de orquestación ajustan los recursos exactamente a lo que requiere una aplicación en varios escenarios de uso, evitando el exceso de aprovisionamiento desenfrenado o que las organizaciones tengan que diseñar y planificar una utilización elevada del agua. Esta eficacia reduce los costes de infraestructura y maximiza el retorno de la inversión.

Simplifica la gestión

Los orquestadores de contenedores proporcionan una interfaz unificada para gestionar clusters de contenedores, abstrayendo tareas complejas y reduciendo la carga operativa. Los equipos pueden implementar actualizaciones, supervisar el estado y aplicar políticas con una intervención manual mínima.

Mejora la seguridad

La orquestación de contenedores mejora la seguridad automatizando la implementación de parches y actualizaciones de seguridad. Aplica políticas de seguridad coherentes en toda la flota de contenedores, lo que reduce el riesgo de vulnerabilidades.

Permite la portabilidad

La orquestación garantiza que las aplicaciones en contenedores permanezcan agnósticas a la infraestructura subyacente, facilitando la portabilidad a través de diferentes entornos de nube y centros de datos in situ.

Acelera los ciclos de implementación

Al automatizar los procesos de implementación, las herramientas de orquestación acortan el tiempo que transcurre entre el desarrollo y la producción, lo que permite una iteración rápida y una comercialización más rápida de las nuevas funciones.

Admite prácticas DevOps

Al integrarse con Canales de CI/CD y mejorar la agilidad del desarrollo de software, la orquestación de contenedores fomenta la colaboración entre los equipos de desarrollo y operaciones. Capacidades como la supervisión de la salud y la autorreparación permiten a los equipos realizar menos tareas de soporte y solución de problemas del sistema, optimizando la productividad de DevOps.

El ecosistema de los contenedores

Sencillamente, el ecosistema de contenedores representa un cambio significativo en el desarrollo y la implementación de aplicaciones. Abarcando una serie de componentes -desde motores de tiempo de ejecución hasta plataformas de orquestación, registros y herramientas de seguridad- ofrece a las empresas la eficacia que exige el vertiginoso panorama digital actual.

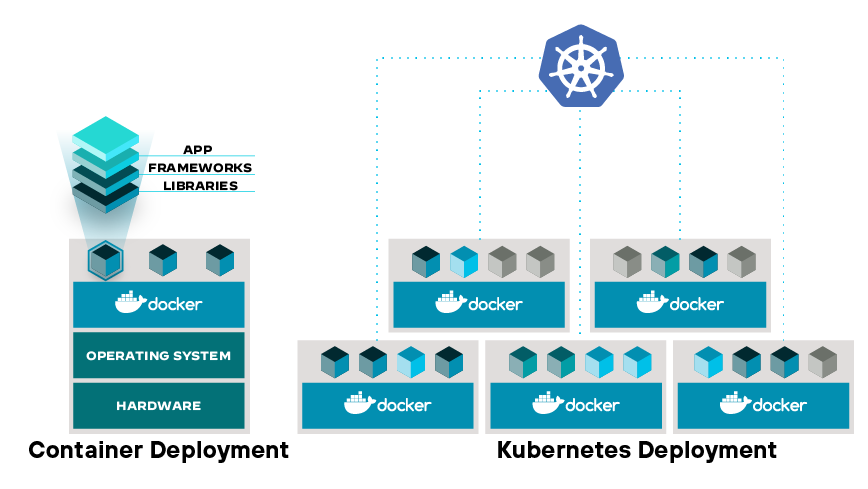

Por supuesto, en el corazón del ecosistema se encuentra la sinergia entre el motor de contenedores y el motor de orquestación. Juntas, estas tecnologías guían a las aplicaciones en contenedores a través de las intrincadas etapas de su ciclo de vida.

El motor de contenedores crea y empaqueta contenedores individuales, mientras que el motor orquestador gestiona y orquesta múltiples contenedores a través de una infraestructura distribuida.

Durante el desarrollo, el motor de contenedores facilita la creación rápida de prototipos y la realización de pruebas, lo que permite a los desarrolladores iterar con rapidez y eficacia. A medida que la aplicación madura, el orquestador la traslada a producción, proporcionando una base sólida y escalable para manejar las cargas de trabajo del mundo real.

Figura 4: Docker y Kubernetes representando la dinámica de los motores de contenedores y orquestación

Implicaciones estratégicas para los líderes empresariales

Agilidad y rapidez en la implementación de software

El ecosistema de contenedores acelera la implementación de aplicaciones. Al encapsular las aplicaciones en contenedores, las organizaciones pueden pasar rápidamente del desarrollo a la producción, independientemente del entorno subyacente. Esta agilidad es crucial para las organizaciones que necesitan adaptarse rápidamente a los cambios del mercado o a las demandas de los usuarios.

Mayor eficiencia y optimización de los recursos

Al ofrecer una alternativa a las máquinas virtuales tradicionales, los contenedores comparten el kernel OS subyacente y consumen menos recursos. Esta eficacia se traduce en una reducción de los costes operativos y una mejor utilización de los recursos informáticos, una ventaja clave para las empresas que gestionan aplicaciones a gran escala.

Escalabilidad y flexibilidad

Vitales para las empresas digitales que experimentan una demanda fluctuante, los orquestadores del ecosistema de contenedores permiten a las empresas escalar sus aplicaciones sin comprometer el rendimiento. El ecosistema de contenedores en su conjunto perfecciona las capacidades anteriores de escalado y disponibilidad de recursos.

Coherencia y portabilidad entre entornos

El ecosistema de contenedores garantiza la coherencia y la portabilidad. Las aplicaciones empaquetadas en contenedores pueden ejecutarse de manera uniforme y fiable en distintos entornos de computación, desde centros de datos in situ hasta nubes públicas.

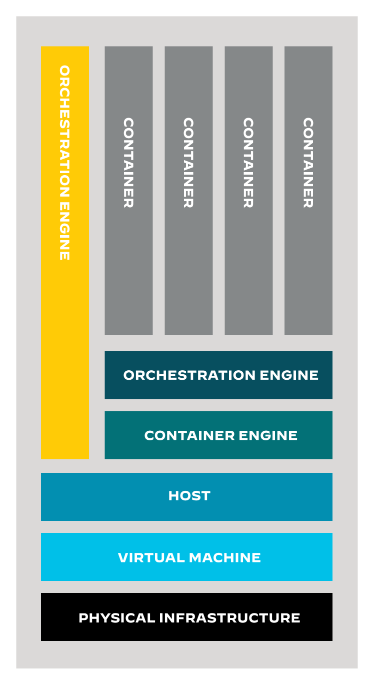

Figura 5: Anatomía de un entorno de contenedores alojados

Prepararse para un futuro impulsado por los contenedores

El futuro apunta a un mundo digital en el que la mayoría de las aplicaciones, si no todas, se ejecutan en contenedores. Para los ejecutivos, comprender la sinergia que hay detrás del ecosistema de los contenedores supone una ventaja estratégica. Contar con un punto de vista informado puede permitirle anticiparse y satisfacer eficazmente las exigencias cambiantes del desarrollo de software moderno, y con un rendimiento óptimo de la inversión.